Бащата на всички чипове с 400 000 ядра – суперкомпютър от ново поколение

Архитектурата на Cerebras: Двигателят на Wafer Scale на Cerebras ускорява изчисляването и комуникацията и по този начин намалява времето за дълбоко обучение (Deep learning). Чипът е 56 пъти по-голям от най-големия графичен процесор.

Тези ядра са създадени специално за работа с AI. Те са малки и бързи, не съдържат кеш и са елиминирали други функции и пречки, които са необходими в ядра с общо предназначение, но не играят полезна роля в процесор за дълбоко обучение (Deep learning).

Cerebras WSE има 18 гигабайта чип памет и 9.6 Petabytes/ sof честотна лента на паметта. Съответно това е 3000 и 10 000 пъти повече от водещия в момента графичен процесор.

Процесът е следния: с всяка нова извадка за обучение, мрежата променя начина, по който прави своите прогнози за изхода, така че непрекъснато намалява грешката; грешката е разликата между прогнозирания изход и правилния изход.

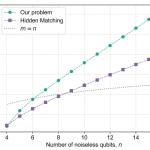

Мащаб: Досега никой никога не е изграждал и не е въвеждал на пазара чип по-голям от 840 квадратни мм. През последните шест години графичните процесори на Nvidia например са нараснали от 551 квадратни милиметра до 815 квадратни милиметра.

Предизвикателствата при проектирането, производството, захранването, охлаждането, комуникацията и координацията са огромни. Но обещанието е огромно. Полученият чип ще бъде 50x по-голям от най-големия чип на пазара днес.

*Законите на Мур са емпирични закони, свързани с непрекъснатото усъвършенстване на производството на интегрални схеми. Първият е формулиран от Гордън Мур, съосновател на Интел, а другите също са наричани от своите създатели „закони на Мур“, но се отнасят също до експоненциалния ръст на други величини и това е общото им с първия. Законите на Мур се отнасят до технологията на микроелектрониката и по-точно до развитието на изчислителната мощ на микропроцесорите и уплътнението на интегралните схеми.